做 listing优化工具对比,管理者先看 4 项:关键词数据源、文案转化力、测试闭环、协作效率。AI 写得快不等于卖得好,能持续提升 CTR 与转化的工具才更值得试。

一个标题写错,点击率常会少一截。工具选错后,团队每周多花的不是订阅费,而是返工、延迟和错过的成交。

反直觉的点在这里:采购时最亮眼的“秒出稿”,往往不是 ROI 第一指标。真正拉开差距的,是“数据源—CTR 优化—转化验证”有没有闭环。

listing优化工具对比先算损失:为什么必须现在做

Amazon 2024 报告提到,独立第三方卖家贡献了 Amazon 商店超过 60% 的销售额(数据来源:Amazon《2024 Small Business Empowerment Report》,2024)。

同一报告还提到,独立卖家在 2023 年的年销售额平均超过 25 万美元(数据来源:Amazon《2024 Small Business Empowerment Report》,2024)。

这说明竞争不是“有没有卖家”,而是“多数类目都在卷”。

在这种盘子里,工具买错,损失会被持续放大。

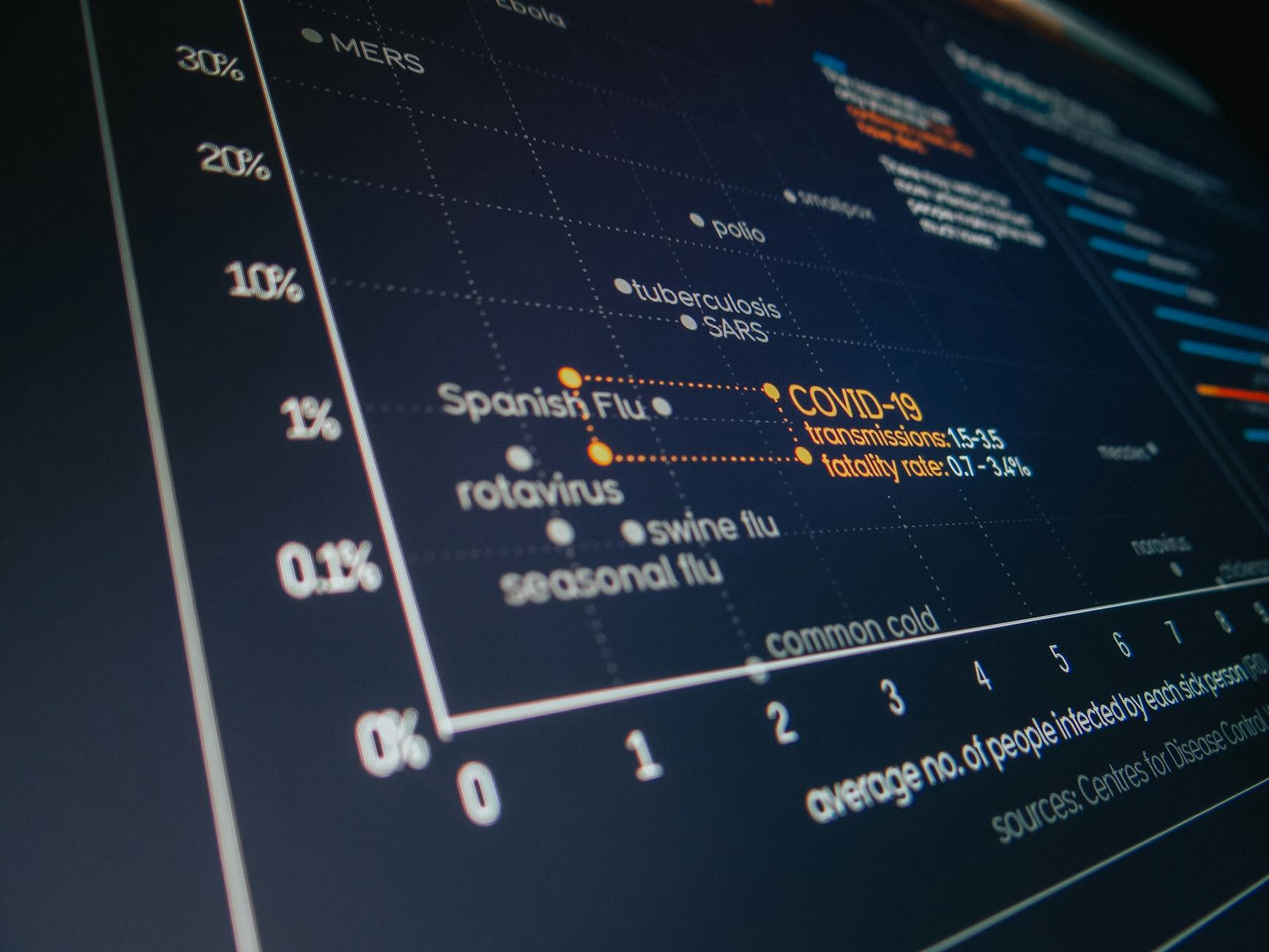

Backlinko 2023 对 400 万个 Google 搜索结果的分析显示,第 1 名平均 CTR 为 27.6%(数据来源:Backlinko,2023)。

排名每上升 1 位,平均 CTR 再提升 2.8%(数据来源:Backlinko,2023)。

对商品页来说,曝光位置每掉一点,点击就少一点。

如果你的标题、词路和卖点不成系统,流量不是慢慢掉,而是整段滑落。

核心结论:做工具采购时,最该算的不是月费,而是错失曝光、点击、转化和人效后的总损失。

曝光损失:关键词没覆盖,流量会从第一页滑到第二页

很多团队只看“有没有词”,不看“词来自哪里”。

数据源浅,类目词和竞品词抓不全,后续文案再顺也很难补回来。

2023 年全球零售电商销售额估计为 5.8 万亿美元(数据来源:Statista,2023)。

盘子越大,类目竞争越细,靠感觉选词的容错率就越低。

转化损失:点击来了,但标题和卖点没接住

Backlinko 2023 研究发现,标题长度在 40 到 60 个字符之间的页面,平均 CTR 最高,为 33.3%(数据来源:Backlinko,2023)。

这提醒管理者,文案不是越长越强,也不是堆词越多越好。

同一研究还发现,带 meta description 的页面,其自然搜索 CTR 比没有的高 5.8%(数据来源:Backlinko,2023)。

底层逻辑很简单:点击前的预期更清楚,点击后的转化基础才更稳。

效率损失:返工才是隐形大头

Amazon 2023 年第四季度披露,独立卖家贡献了 Amazon 商店 60% 的销售额(数据来源:Amazon,2023)。

卖家越多,团队越需要统一流程,而不是靠个人经验硬扛。

按 100 个 SKU、每周迭代 1 次来算,人工流转常见会经过运营、设计、广告 3 轮确认。

实操里,一次文案返工拉长半天到两天,并不罕见。

- 订阅费是显性成本

- 曝光滑落是机会成本

- 返工与等待是管理成本

- 无法复盘才是长期成本

下一步就该换个角度看工具。

不要再问“谁写得快”,而要问“谁能闭环”。

别只看AI写得快:4个指标决定工具值不值得买

大多数人做 listing优化工具对比,第一眼看的是生成速度。

但真正决定 ROI 的,往往不是 30 秒出稿,而是 30 天后还能不能证明它有效。

我更建议用一个原创框架来打分:源-点-验-协四环尺。

源看数据,点看点击,验看结果,协看团队。

10 分制评分表

| 维度 | 看什么 | 低分信号 | 高分信号 | 分值 |

|---|---|---|---|---|

| 源 | 关键词数据深度 | 只给泛词 | 能反查类目与竞品 | 10 |

| 点 | 文案 CTR 能力 | 只会堆词 | 能改标题结构与卖点顺序 | 10 |

| 验 | 测试与回看 | 无版本记录 | 有对照、回看、导出 | 10 |

| 协 | 协作与批量 | 单人单站点 | 多角色、多站点、批量改写 | 10 |

40 分里,我建议把“验”权重提到最高。

因为没有验证,前 3 项都只是演示能力。

指标 1:关键词数据源够不够深

真正好用的数据源,不只给搜索词。

它还能支撑类目拆分、竞品反查、评论痛点和词路优先级。

如果工具只会吐一串高频词,采购风险很大。

你得到的是“写作素材”,不是“决策底座”。

指标 2:优化目标是不是围绕 CTR 与转化

标题、五点和描述都可以写。

但能不能把“谁先出现、谁后出现、谁负责点击”讲明白,差异很大。

Backlinko 的结论已经很直白:40 到 60 字符的标题,平均 CTR 更高,为 33.3%(数据来源:Backlinko,2023)。

所以“多写一点更保险”并不总成立。

指标 3:有没有版本管理和结果回看

AI 起稿只是起点。

如果没有版本号、修改记录和结果回看,团队很快会陷入“都改了,但不知道哪次有效”。

反直觉的一点是:

工具越花哨,如果没有验证层,越容易让团队误以为自己在优化。

指标 4:是否支持多站点、多人协作和批量改写

一旦进入多 SKU、多站点、多语种阶段,单点功能价值会快速下降。

真正省时间的,不是一次写得多漂亮,而是同一规范能否稳定复制。

- 数据可信度:看站点、类目、竞品覆盖

- 可执行性:看标题与卖点是否能直接落地

- 验证能力:看是否支持版本、导出、结果复盘

- 协同能力:看是否支持多人、多站点、批量流程

下面进入最关键的部分。

不是排“最好”,而是拆清“哪类方案适合谁”。

7款listing优化工具对比:谁适合试用,谁不该买

这类对比最容易写成“总榜”。

但商业决策不该只看总分,而该看短板是否刚好踩中你的业务瓶颈。

基于官网功能页、定价页和公开测评,市面方案大致可分成 7 类。

比起盯品牌名,管理者更该盯“能力模型”。

核心对比表

| 工具类型 | 适用平台 | 核心优势 | 明显短板 | 适合团队规模 | 学习成本 | 是否适合中文团队 | 试用建议 |

|---|---|---|---|---|---|---|---|

| Amazon 关键词型 | Amazon | 词库深、类目强 | 文案闭环弱 | 3-20 人 | 中 | 较友好 | 先测反查词 |

| 中文数据分析型 | Amazon | 中文界面、上手快 | 海外 SEO 视角弱 | 2-15 人 | 低 | 高 | 先测选词准确性 |

| 新手流程型 | Amazon | 建流程快 | 深度分析有限 | 1-8 人 | 低 | 中 | 先测首批 SKU |

| 报表监控型 | Amazon/品牌 | 数据看板强 | 起稿能力弱 | 5-30 人 | 中高 | 中 | 先测复盘效率 |

| 卖家情报型 | Amazon | 竞店与类目洞察 | 文案执行弱 | 3-20 人 | 中 | 中 | 先测竞品研究 |

| AI 起稿型 | Amazon | 起稿快 | 同质化风险高 | 1-10 人 | 低 | 中 | 必做二次校验 |

| 独立站 SEO 型 | Shopify/站外 | Google 页面优化强 | 不等于站内 listing | 2-20 人 | 中 | 中 | 只用于站外页 |

这个表有一个核心判断:

“数据底座型”和“AI 写稿型”不是同一类预算。

前者解决的是“该写什么”。

后者解决的是“如何更快写出来”。

7 类方案的实操判断

- 关键词型:适合重运营团队

- 数据分析型:适合中文团队快速判断词路

- 新手流程型:适合刚建流程的小团队

- 报表监控型:适合品牌部和管理层

- 卖家情报型:适合做竞品研究

- AI 起稿型:适合加速,不适合单独决策

- 独立站 SEO 型:适合商品页收录与 CTR 提升

很多团队误买,问题不在功能少。

而在于把“写稿器”当成了“增长系统”。

所以别问“能不能全包”。

更该问:“它最强的一环,是否正好补你当前最贵的短板?”

按阶段选工具:新店、增长期、品牌团队的配置完全不同

没有一种方案适合所有卖家。

更划算的做法,是按阶段买对组合,而不是一次买满功能。

Amazon 2024 报告显示,独立卖家在 2023 年的年销售额平均超过 25 万美元(数据来源:Amazon《2024 Small Business Empowerment Report》,2024)。

这意味着很多团队会从小体量,较快进入需要流程化的阶段。

分阶段预算与回报区间表

| 阶段 | 常见团队 | 月预算上限 | 试用时长 | 预期回报周期 |

|---|---|---|---|---|

| 新店 | 1-3 人,10-50 SKU | 300-800 美元 | 7-14 天 | 4-8 周 |

| 增长期 | 3-8 人,50-300 SKU | 800-2500 美元 | 14-21 天 | 6-10 周 |

| 品牌期 | 8 人以上,多站点 | 2500-8000 美元 | 21-30 天 | 8-12 周 |

这不是统一报价表。

而是管理者更容易落地的试用区间。

新店阶段:先解决上架速度和基础关键词覆盖

新店最怕一上来就买重型系统。

因为 SKU 不够、流程未定,很多高级功能暂时用不上。

优先级通常只有两件事:

把基础词补齐,把标题和卖点先跑通。

增长阶段:重点看批量优化、竞品追踪和版本复盘

SKU 一多,返工开始失控。

这时只会写稿的方案价值会下降,能批量处理和复盘的方案价值会上升。

如果团队每周都在改页面,却说不清哪版有效,说明你缺的不是文案。

你缺的是验证层。

品牌阶段:要求多市场协同、规范化流程和数据沉淀

品牌阶段最贵的不是某一次转化损失。

而是多站点口径不一致,导致内容、广告和设计都反复重做。

这时采购标准要从“能不能用”,升级成“能否沉淀规范”。

包括权限、模板、导出、审校和跨站点复用。

- 新店:轻量、快试、少花冤枉钱

- 增长期:批量、复盘、压缩返工

- 品牌期:协同、规范、沉淀资产

真正稳的采购,不是看演示做决定。

而是拿真实 SKU 跑一次 7 天试用。

采购前先跑7天:一张试用清单筛掉不合格工具

销售演示最容易把人带偏。

因为演示看的通常是“顺的时候”,而不是“业务真实摩擦”。

更稳的方法,是所有候选方案都跑同一张清单。

只要标准统一,不合格方案会很快暴露。

7天试用任务表

| 天数 | 任务 | 责任人 | 产出 | 淘汰标准 |

|---|---|---|---|---|

| Day1 | 选 3 个 SKU 建基线 | 运营 | 旧版数据表 | 基线不清 |

| Day2 | 拉关键词并分层 | 运营/广告 | 词表 | 词源不明 |

| Day3 | 改标题与卖点 | 运营 | 新版文案 | 只会堆词 |

| Day4 | 做描述与图片文案 | 运营/设计 | 页面草稿 | 协作卡顿 |

| Day5 | 建版本记录 | 运营 | V1/V2 表 | 无版本管理 |

| Day6 | 回看 CTR 与会话 | 运营/广告 | 对照表 | 无法导出 |

| Day7 | 复盘与采购会 | 主管 | 结论单 | 无法量化收益 |

这张表故意不复杂。

因为采购前最重要的,不是做全,而是快速识别短板。

必问供应商的 5 个问题

- 数据更新频率是多少

- 覆盖哪些站点和类目

- 是否支持多人权限

- 是否支持导出和版本留痕

- 试用期能否跑真实业务流程

如果对方只能展示“生成效果”,却答不清数据口径和回看方式,风险就很高。

这类方案常常适合演示,不一定适合落地。

管理者拍板标准

我建议只看 3 个结果项。

少看一堆花哨功能,多看真实变化。

- 迭代周期是否缩短

- 点击率是否出现改善

- 跨团队返工是否减少

核心结论:能把关键词、文案和结果验证串起来的工具,哪怕功能没那么炫,通常也比“只会秒出稿”的方案更值钱。

如果 7 天后,团队还是说不清“哪次修改有效”,那就别急着买。

因为你买到的多半只是加速器,不是增长闭环。

你在 Google 上还会继续追问的 3 个问题

Q:listing优化工具到底比人工优化强在哪?

强项不只是写得更快。

它更大的价值,是把关键词挖掘、竞品参考、批量生成、版本迭代和结果复盘串成流程。

如果团队只有少量 SKU,人工加表格也能跑。

但当你要做多站点、多语种、多运营协同时,工具价值才会明显放大。

Q:AI生成的listing文案会不会同质化,反而影响转化?

会,尤其是只靠通用大模型直接出稿时。

常见问题是卖点空泛、关键词堆叠、语气不符合类目习惯。

避免同质化的关键,不是完全不用 AI。

而是把真实关键词、竞品差异、评论痛点和历史结果一起喂进去,再经过人工审校。

Q:做Amazon和独立站商品页优化,能用同一套工具吗?

能部分复用,但不能完全等同。

Amazon listing 更强调站内规则、类目词和平台表达。

独立站商品页还要考虑 Google 收录、标题标签、meta description 和页面结构。

所以更稳的做法,是把“站内商品优化”和“站外 SEO 页面优化”拆开看。

如果你已经看清楚:真正该比的不是“谁生成得更快”,而是谁能把关键词、文案和结果验证真正串起来,那么下一步就不是继续看测评,而是亲自跑一次试用。

即刻扫码添加企业微信,获取专属 AI 解决方案

也可以留下您的需求,资深专家将与您一对一联系。